Зображення «хлопчика із Дніпра» розбило серця численних користувачів соцмереж. «Бідній дитинці» співчували, нею пишалися і навіть почали розшукувати, щоб допомогти… Разом із тим, ця ілюстрація стала класикою жанру в питаннях ідентифікації фотофейків. Що не так із відомою «світлиною», чому іноді треба сказати – «не вір очам своїм» і яку небезпеку несуть подібні зображення?

Фактчекінг-дослідження провело херсонське видання «Новий день».

14 січня 2023 року. Світ шокував російський удар по м. Дніпро. Ракета влучила у дев’ятиповерхівку, повністю зруйнувавши два під’їзди. Це був вихідний, і вдома перебували багато мешканців висотки. Рятувально-пошукова операція з розбиранням завалів тривала чотири дні. За даними ДСНС, загинули 46 людей, зокрема, 6 дітей, 79 – отримали травми різного ступеню тяжкості, серед них 16 дітей. Без даху над головою залишилися мешканці 302 квартир. У пам’ять про невинних жертв російської агресії у Дніпрі тоді оголосили триденну жалобу.

Рятувальники розбирають завали на місці ракетного удару у Дніпрі. Фото ДСНС

Про підозру у вчиненні воєнного злочину, який спричинив тяжкі наслідки – масову загибель людей, Офіс Генпрокурора повідомив командиру 52-го гвардійського важкого бомбардувального авіаційного полку ЗС РФ.

«Ми зробили 3D-модель зруйнованого російською ракетою будинку для документування наслідків удару, а також чіткого розуміння напряму польоту цієї ракети і порядку її руху. Встановили бортовий номер літака Ту-22М3, який використовувався для нанесення ракетно-бомбового удару. А також весь ланцюжок осіб, які причетні до нього. Один з них – командувач дальньої авіації повітряно-космічних сил ЗС РФ станом на січень 2023 року. Наразі йому також підготовлено повідомлення про підозру», – на річницю ракетного удару зазначив заступник начальника Департаменту протидії злочинам, вчиненим в умовах збройного конфлікту, Офісу Генпрокурора Тарас Семків.

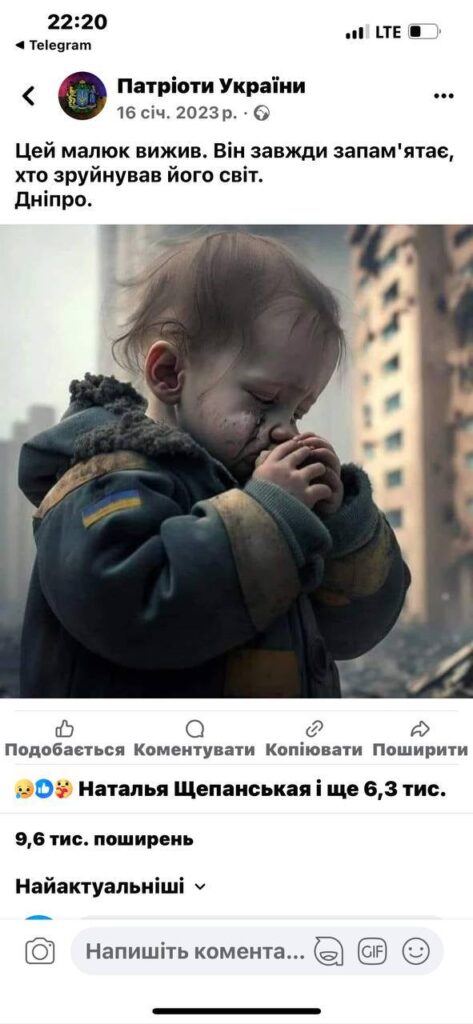

16 січня 2023 року. Декілька спільнот у фейсбуці поширюють публікацію із зображенням маленького хлопчика у куртці з нашивкою у вигляді синьо-жовтого прапора на рукаві, дитина плаче, склавши руки біля носа. Під «світлиною» – щемкий підпис: «Цей малюк вижив. Він назавжди запам’ятає, хто зруйнував його світ. Дніпро».

Подібну публікацію у перші дні після ракетного удару у Дніпрі побачили й користувачі твіттера. Пост з’явився на офіційній сторінці Верховної Ради України, щоправда, вже за 20 хвилин його видалили. Загалом публікації з «фото» малого у соцмережах розлетілися зі швидкістю блискавки, це поширили тисячі користувачів, сотні – написали свої коментарі. Ось деякі з них:

«Господи Боже, захисти цю дитину, дай йому хороших і щирих людей», «Бідне дитятко, Боже, допоможи, дай здоров’я та щасливе майбутнє», «Таке маленьке невинне янголятко. Це чиєсь маленьке сонечко, золото, найцінніший скарб… Його обідили, скривдили, нанесли велику біль. Душа болить. Як це зупинити???»

Серед тих, хто щиро повірив у реальність хлопчика, який плаче на місці ракетного удару, була жителька Херсона, 49-річна Наталя Головата, користувачка фейсбуку.

«Я теж скопіювала тоді собі на сторінку цю публікацію. А хіба тут можна було відреагувати по-іншому? Дитина плаче, я подумала, може й, батьки загинули в неї отам, під тими руїнами. А воно, бідненьке, однісіньке в цьому світі, і таке гарненьке, наше, українське дитя. Страшна несправедливість, що й говорити. Ну а потім видалила пост, бо подруга написала, що типу це все неправда. Всі мої знайомі видали, ну і я так зробила. Хоча, якщо чесно, фото як фото, не розумію, що з ним не те», – розповіла «Новому дню» Наталя.

Як діяти, коли поширив фейк:

- Якщо допис опубліковано нещодавно і він ще не встиг набрати перегляди, лайки, коментарі, краще його видалити.

- Якщо публікація вже достатньо популярна, слід надати upd зі спростуванням у тексті та відкоригувати картинку (протитрувати – «Фейк» або «Увага! Фейк!»).

- Чому це важливо: коли текст просто видаляється, користувачі, які встигли його прочитати, лишаються непоінфомованими про фейк.

Ще одна користувачка фейсбуку, 19-річна Олександра Кучерова з Києва, розповіла «Новому дню», що «світлину з малим із Дніпра» не перепощувала.

Дівчина, яка любить малювати і опановує фах дизайнера, одразу побачила ознаки штучності на картинці.

«/Є локони, але без структури волосся. Воно виглядає розмитим та димчатим, не видно самих волосин, ніби їх заблюрили. Вухо не відповідає анатомічній структурі, сильно затемнене, неприродньо червоне. Про пальці – тут взагалі смішно. Великий палець як зламаний, він росте вище, ніж анатомічно має бути, в нього занадто різкі згини. Всі пальці деформовані, вони занадто звужені на кінчиках і незрозуміло, звідки ростуть нігті, вони виглядають приклеєними. Сльози – чомусь насичено чорні і аж вдавлені в обличчя, як шрам, так не буває. Одяг теж дивний: капюшон не має крою. Оцей нижній темний пух іде в нікуди», – поділилася враженнями Олександра.

Зображення, які Олександра Кучерова надіслала редакції «Нового дня» до свого коментаря

Феномен «хлопчика із Дніпра» в тому, що ніякого хлопчика не було. Його згенерувала нейромережа. Така експертна думка щодо зображення, яке стало вірусним. По коментар «Новий день» звернувся до першої секретаря Національної спілки журналістів України, членкині Комісії з журналістської етики Ліни Кущ. Минулоріч вона презентувала власний навчальний курс «Використання штучного інтелекту в роботі медіа», досліджувала ситуацію з поширенням фейків, згенеровах ШІ, зокрема, серед прикладів вивчала те саме «фото хлопчика з Дніпра».

– Зараз люди ще не готові до того, що штучний інтелект використовується для створення зображень, які ілюструють реальні події. Люди готові повірити в те, що є потерпілий хлопчик, який реально постраждав внаслідок удару по Дніпру. Якщо чесно, тут необхідні надивленність, певний досвід, адже для звичайної людини важко відрізнити фейк від реального фото. Але ж можна додивитися, що деякі елементи картинки з хлопчиком виглядають неправдоподібно. Ще у таких зображеннях, як правило, спостерігається надзвичайна награність, драматизм. Маленький хлопчик з виразом обличчя як у дорослої людини, яка багато чого пережила, він плаче не як дитина. Надмірна експресивність в ілюстрації застосовується для привернення уваги. Також у подібних картинках нерідко спостерігається бажання зіграти на патріотизмі нації. Так, на куртці хлопчика з того самого фото добре видно нашивку в кольорах українського прапору. Це продумана маніпуляція свідомістю людей, які побачать цю світлину в соцмережах. І ще одна важлива умова – такі фото нерідко з’являються на тлі резонансних подій, коли градус сприйняття зашкалює. Саме це спрацювало у випадку з вигаданою історією про «хлопчика із Дніпра», – говорить експертка.

Експертка Ліна Кущ та журналістка Марина Савченко – аналіз зображення, згенерованого ШІ. Фото «Нового дня»

Разом з тим, експертка вважає, що пересічний читач, глядач і не повинен досконально розбиратися у складних моментах ШІ. Простий і дієвий лайфхак як не спійматися на фейк – дивитися новини перевірених ЗМІ, там де є відповідальність за створення контенту. У березні 2024 року Європарламент під час пленарного засідання у Страсбурзі ухвалив Акт, що регулюватиме права у сфері штучного інтелекту (Artificial Intelligence Act). Нові правила забороняють використання деяких програм ШІ, що можуть загрожувати правам людини, зокрема, певні біометричні системи з ідентифікацією облич з використанням камер спостереження і т.д. Наступний крок – імплементація акту всіма членами ЄС. Є сподівання, що ці стандарти прийме й Україна. Ліна Кущ зауважила, що був один час, коли на неправдиві фото, згенеровані ШІ, велися навіть авторитетні видання, ілюстручи ними матеріли про реальні події. Зокрема, кілька відомих агенцій видали за справжнє фото штучно згенеровану картинку начебто з вибухом у Сирії. Але наразі тенденція змінилася і контент, згенерований нейромережею, фактично неможливий у відомих медіа.

– У світових інформаційних агенціях існують дуже суворі правила щодо корекції фото, які використовуються в матеріалах. Наприклад, червоні очі не коригуються. Ставляться до цього питання більш критично і відповідально. Перевіряють джерела, мета-дані кожного файлу. Одна справа якщо це з’явилося на сторінці відомого медіа або інформаційної агенції, інша – якщо це сторінка в соцмережах. Якщо журналіст не може перевірити достовірність фото, якщо не впевнені у джерелі фото і не знаєте, коли й ким воно було зроблене, краще не брати його взагалі. Перевірка ілюстрації – незамінна частина фактчекінгу. Актуальні події ілюструються лише актуальними фото, – говорить Ліна Кущ.

У чому загрози поширення зображень, згенерованих ШІ?

Фактчекери, медіаексперти та інші дотичні до сфери фахівці наголошують на тому, що нейрокартинки створюються з певною метою. Нерідко вони спрямовані на завдання, продиктоване пропагандистами, зокрема, російськими. Банально може вивчатися, як аудиторія сприймає вкиди і наскільки легко здатна долучитися до розкачування фейків. Для початку це може бути щемке зображення з дитиною, а далі підсунуть більш складний рівень експерименту. Наприклад, штучно згенеровані зображення можуть вкидатися для підсилення російських інформаційно-психологічних операцій (ІПСО). Це достатньо дешевий спосіб маніпулювання громадською думкою, з огляду на те, що останніми роками традиційні канали комунікації значно програють на інформаційному просторі у порівнянні із соцмережами. Завдяки інструментам із публікаціями картинок ШІ російські пропагандисти легко підбирають ключик до свідомості користувачів, а ті про це й не здогадуються. Так просуваються наративи, потрібні країні-агресору.

Якщо ж говорити про наслідки масового поширення фейкових зображень – головно це про появу недовіри суспільства до реальних фото і подій. Тож важливо не просто знати, як не потрапляти на «гачки», згенеровані ШІ. Кожен відповідальний за достовірність інформації на власній сторінці. Картинка, згенерована нейромережею, ставить під сумнів сам акаунт. І коли це набуває ознак тенденції, зникає довіра до інформаційних платформ, і це не лише соцмережі, а й медіa.

Тему досліджувала Марина Савченко